Come funziona Archivarix?

Il sistema Archivarix è progettato per scaricare e ripristinare siti non più accessibili da Web Archive e quelli attualmente online. Questa è la differenza principale rispetto al resto dei "downloader" e dei "parser del sito". L'obiettivo di Archivarix non è solo quello di scaricare, ma anche di ripristinare il sito Web in una forma che sarà accessibile sul tuo server.

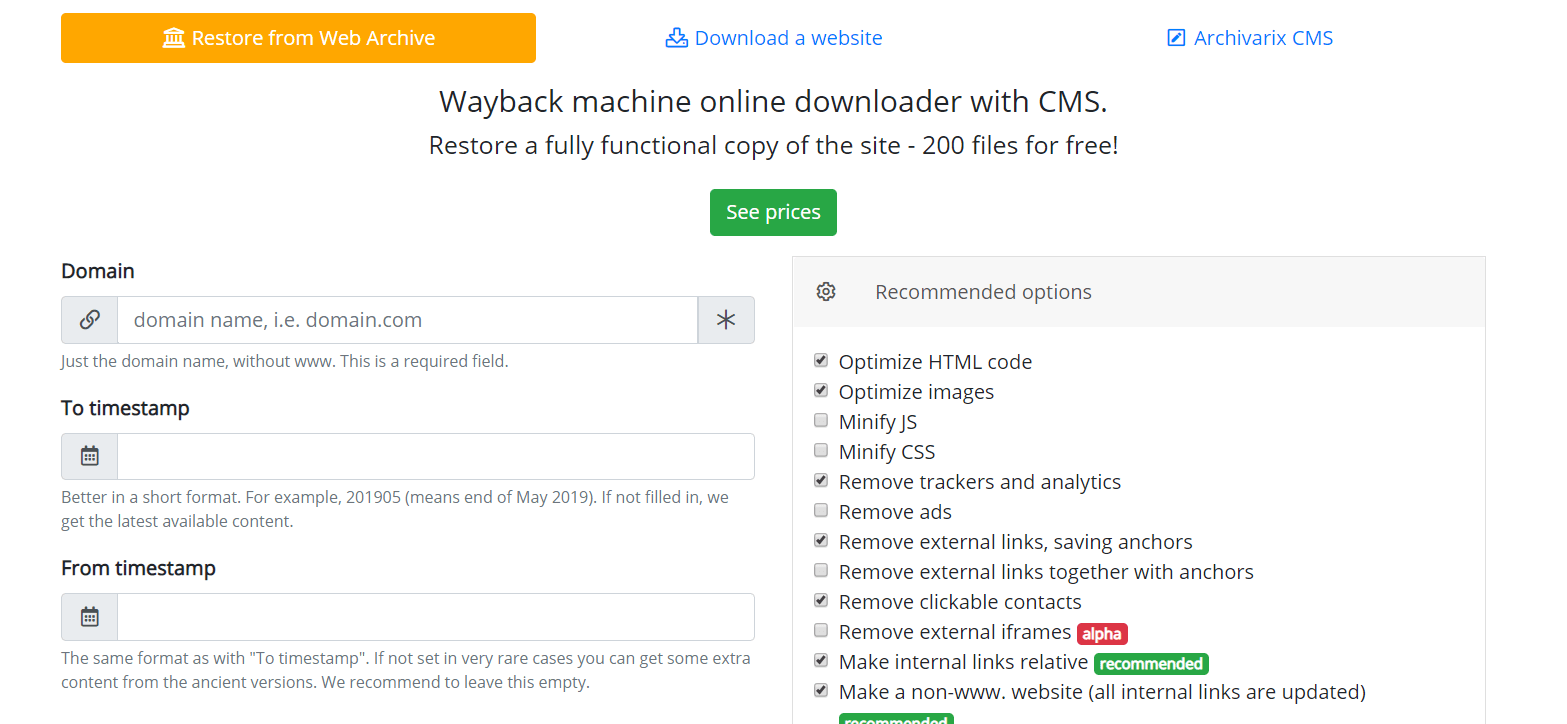

Cominciamo con il modulo che scarica i siti Web da Web Archive. Questi sono server virtuali situati in California. La loro posizione è stata scelta in modo tale da ottenere la massima velocità di connessione possibile con il Web Archive stesso, poiché i suoi server si trovano a San Francisco. Dopo aver inserito i dati nell'apposito campo nella pagina del modulo https://it.archivarix.com/restore/, prende uno screenshot del sito Web archiviato e si rivolge all'API Web Archive per richiedere un elenco di file contenuti nella data di recupero specificata .

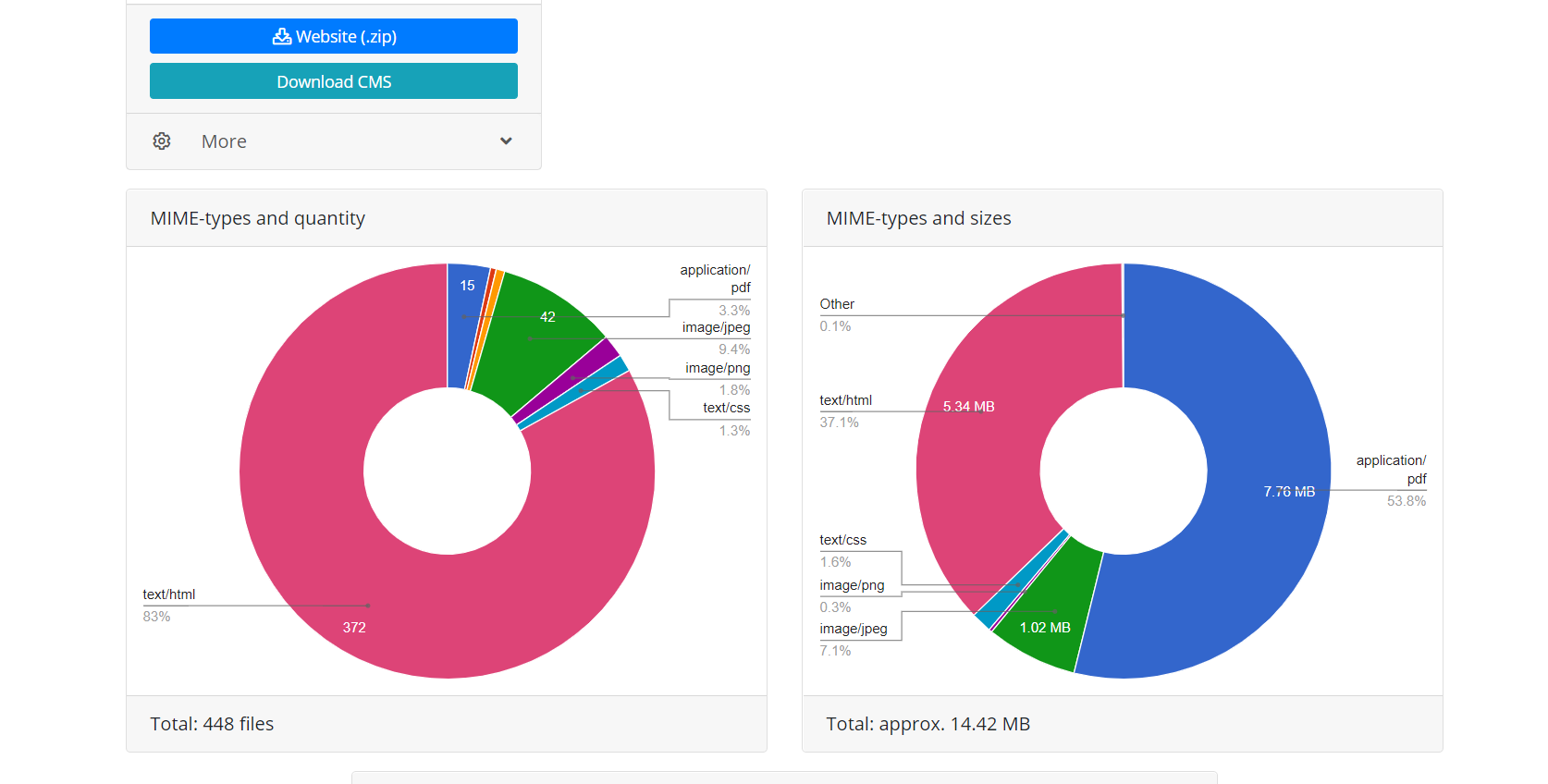

Dopo aver ricevuto una risposta alla richiesta, il sistema genera un messaggio con l'analisi dei dati ricevuti. L'utente deve solo premere il pulsante di conferma nel messaggio ricevuto per iniziare a scaricare il sito Web.

L'uso dell'API Web Archive offre due vantaggi rispetto al download diretto quando lo script segue semplicemente i collegamenti del sito Web. Innanzitutto, tutti i file di questo recupero sono immediatamente noti, è possibile stimare il volume del sito Web e il tempo necessario per scaricarlo. A causa della natura dell'operazione Web Archive, a volte funziona in modo molto instabile, quindi sono possibili interruzioni della connessione o download incompleto dei file, pertanto l'algoritmo del modulo verifica costantemente l'integrità dei file ricevuti e in tali casi tenta di scaricare il contenuto ricollegandosi a il server Web Archive. In secondo luogo, a causa delle peculiarità dell'indicizzazione del sito Web tramite Web Archive, non tutti i file del sito Web possono avere collegamenti diretti, il che significa che quando si tenta di scaricare un sito Web semplicemente seguendo i collegamenti, questi non saranno disponibili. Pertanto, il ripristino tramite l'API Web Archive utilizzata da Archivarix consente di ripristinare la massima quantità possibile di contenuto del sito Web archiviato per una data specifica.

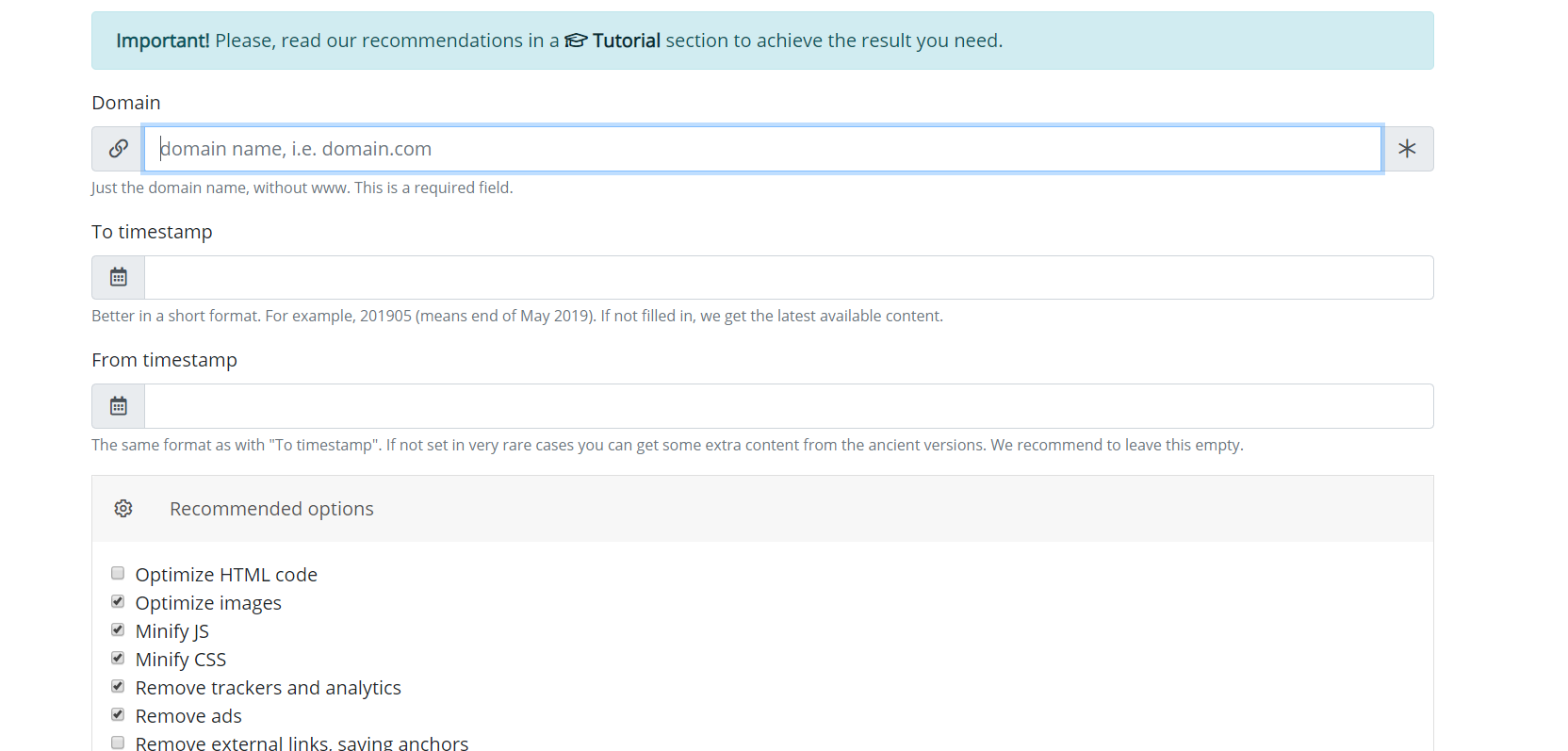

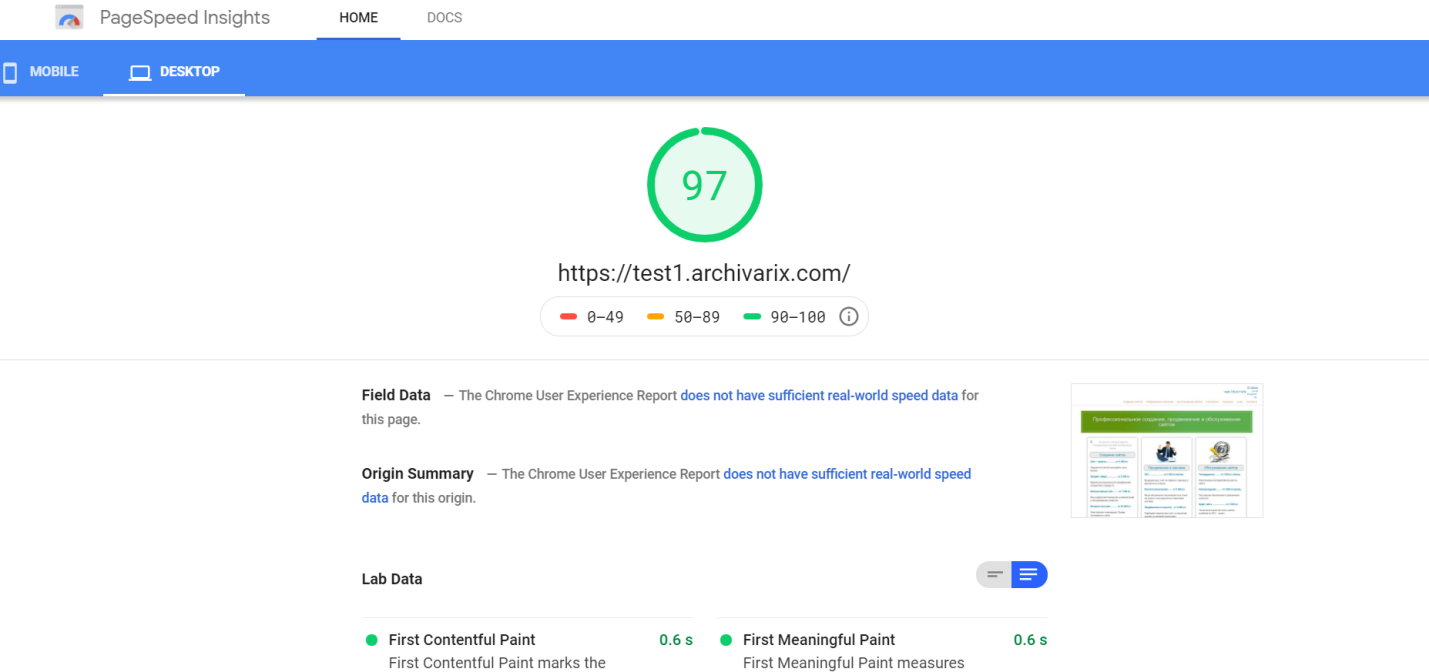

Dopo aver completato l'operazione, il modulo di download dall'archivio Web trasferisce i dati al modulo di elaborazione. Forma un sito Web dai file ricevuti adatto per l'installazione su server Apache o Nginx. Il funzionamento del sito Web si basa sul database SQLite, quindi per iniziare è sufficiente caricarlo sul server e non è necessaria l'installazione di moduli aggiuntivi, database MySQL e la creazione dell'utente. Il modulo di elaborazione ottimizza il sito Web creato; include l'ottimizzazione delle immagini, nonché la compressione CSS e JS. Potrebbe aumentare significativamente la velocità di download del sito Web ripristinato, se confrontato con il sito Web originale. La velocità di download di alcuni siti Wordpress non ottimizzati con un sacco di plugin e file multimediali non compressi può essere notevolmente aumentata dopo l'elaborazione da questo modulo. È ovvio che se il sito Web è stato inizialmente ottimizzato, ciò non aumenterà notevolmente la velocità di download.

Il modulo di elaborazione rimuove la pubblicità, i contatori e le analisi controllando i file ricevuti rispetto a un ampio database di fornitori di pubblicità e analisi. La rimozione di collegamenti esterni e contatti cliccabili avviene semplicemente tramite il codice di checksum. In generale, questo algoritmo esegue una pulizia abbastanza efficiente del sito Web delle "tracce del precedente proprietario", sebbene a volte ciò non escluda la necessità di correggere manualmente qualcosa. Ad esempio, l'algoritmo non eliminerà uno script Java auto-scritto che reindirizza l'utente del sito Web a un determinato sito Web di monetizzazione. A volte è necessario aggiungere immagini mancanti o rimuovere residui non necessari, come libro degli ospiti spammato. Pertanto, è necessario assumere un editor del sito Web risultante. Ed esiste già. Si chiama Archivarix CMS.

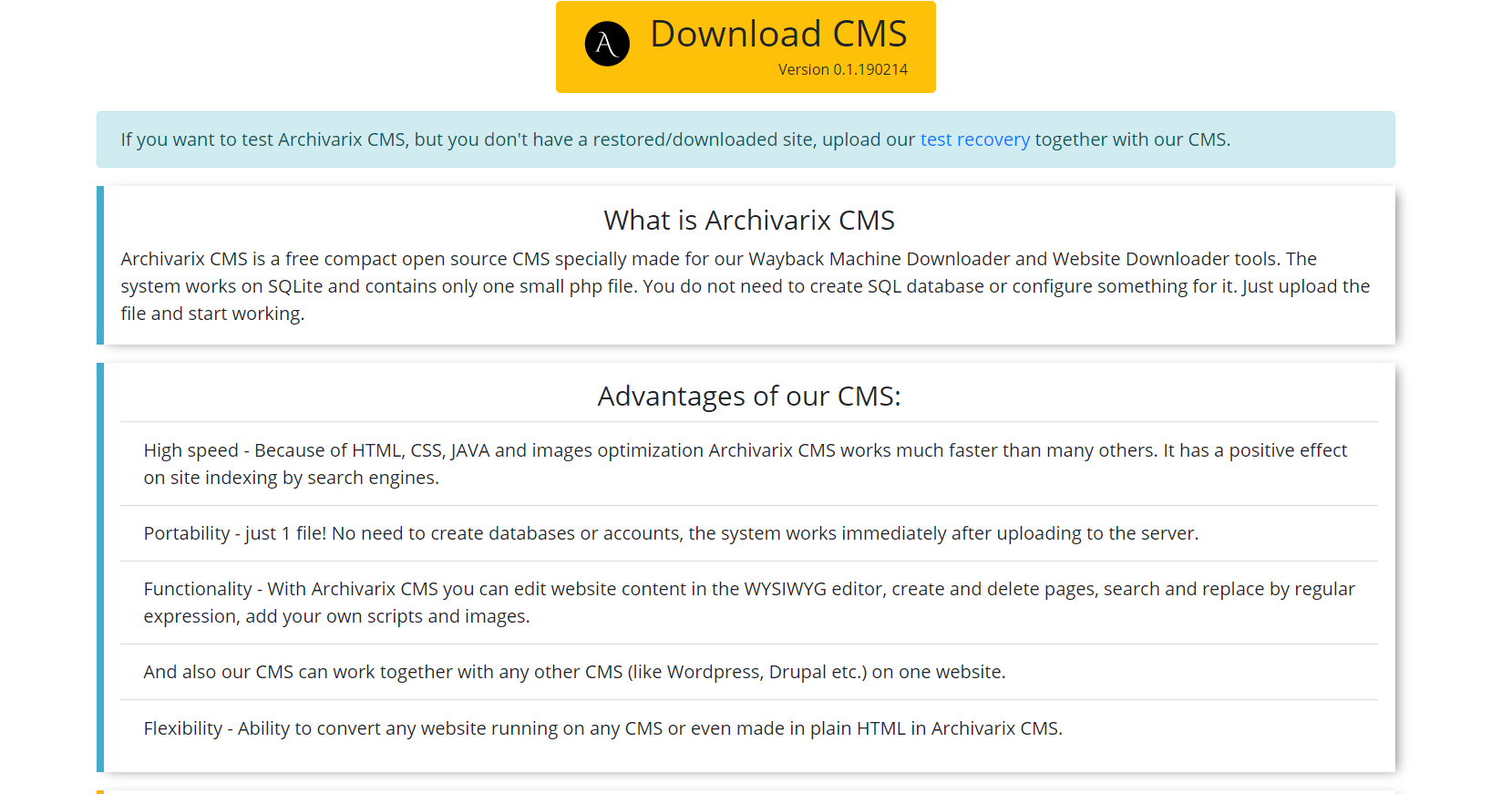

Questo è un CMS semplice e compatto progettato per la modifica di siti Web creati dal sistema Archivarix. Permette di cercare e sostituire il codice in tutto il sito Web usando espressioni regolari, modificando il contenuto nell'editor WYSIWYG, aggiungendo nuove pagine e file. Archivarix CMS può essere utilizzato insieme a qualsiasi altro CMS su un sito Web.

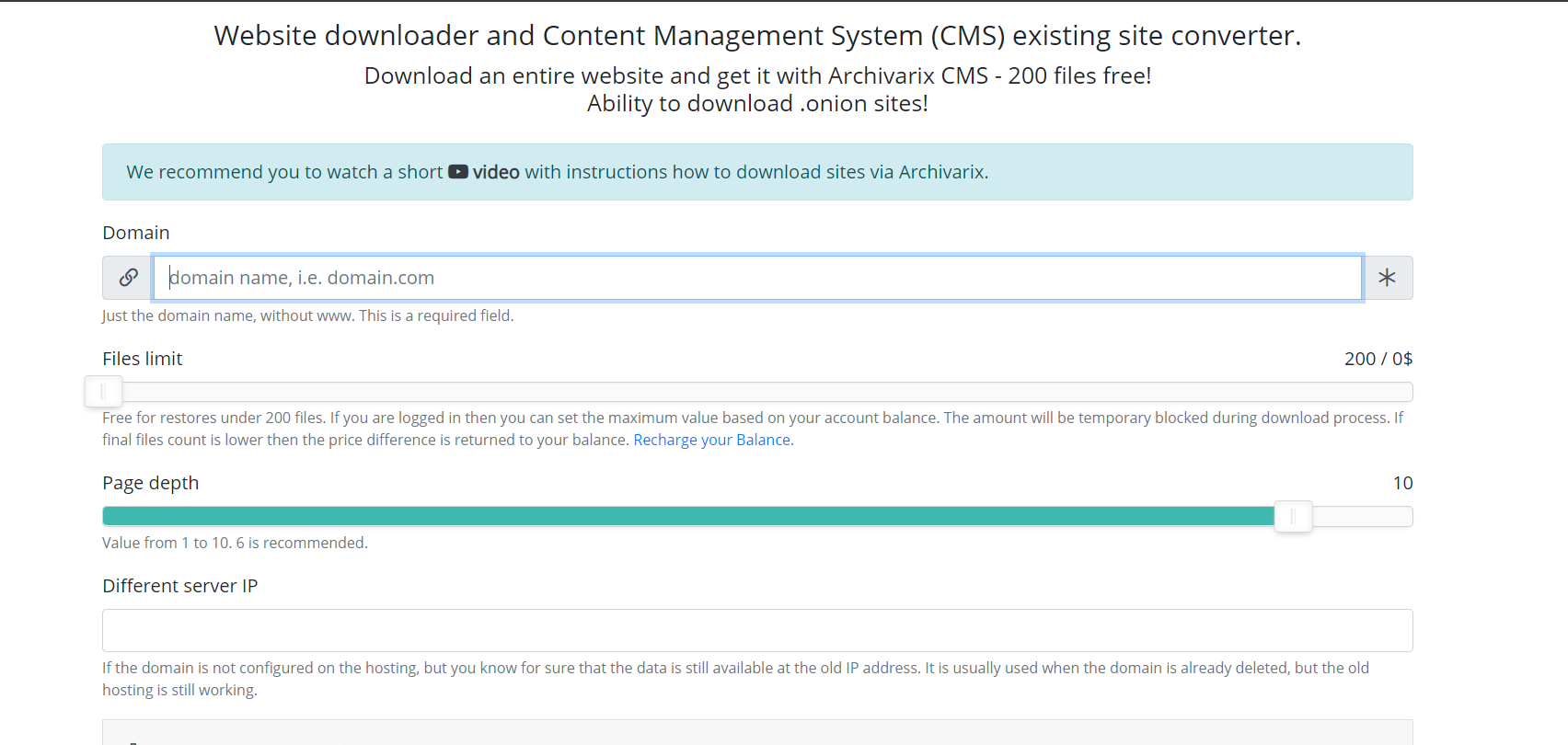

Parliamo ora di altri moduli utilizzati per il download di siti Web esistenti. A differenza del modulo per il download di siti Web dall'archivio Web, è impossibile prevedere quanti e quali file è necessario scaricare, quindi i server del modulo funzionano in un modo completamente diverso. Server spider segue semplicemente tutti i collegamenti presenti su un sito Web che si intende scaricare. Affinché lo script non rientri nel ciclo infinito di download di qualsiasi pagina generata automaticamente, la profondità massima del collegamento è limitata a dieci clic. E il numero massimo di file che è possibile scaricare dal sito Web deve essere specificato in anticipo.

Per il download più completo del contenuto di cui hai bisogno, ci sono diverse funzionalità che sono state inventate in questo modulo. Puoi selezionare un altro spider del servizio User-Agent, ad esempio Chrome Desktop o Googlebot. Referrer per il cloaking bypass: se devi scaricare esattamente ciò che l'utente vede quando ha effettuato l'accesso dalla ricerca, puoi installare un referrer di Google, Yandex o di altri siti web. Al fine di proteggere dal divieto tramite IP, è possibile scegliere di scaricare il sito Web utilizzando la rete Tor, mentre l'IP del servizio spider cambia casualmente all'interno di questa rete. Altri parametri, come l'ottimizzazione delle immagini, la rimozione degli annunci e l'analisi sono simili ai parametri del modulo di download dal Web Archive.

Al termine del download, il contenuto viene trasferito al modulo di elaborazione. I suoi principi di funzionamento sono completamente simili all'operazione con il sito Web scaricato dall'Archivio Web sopra descritto.

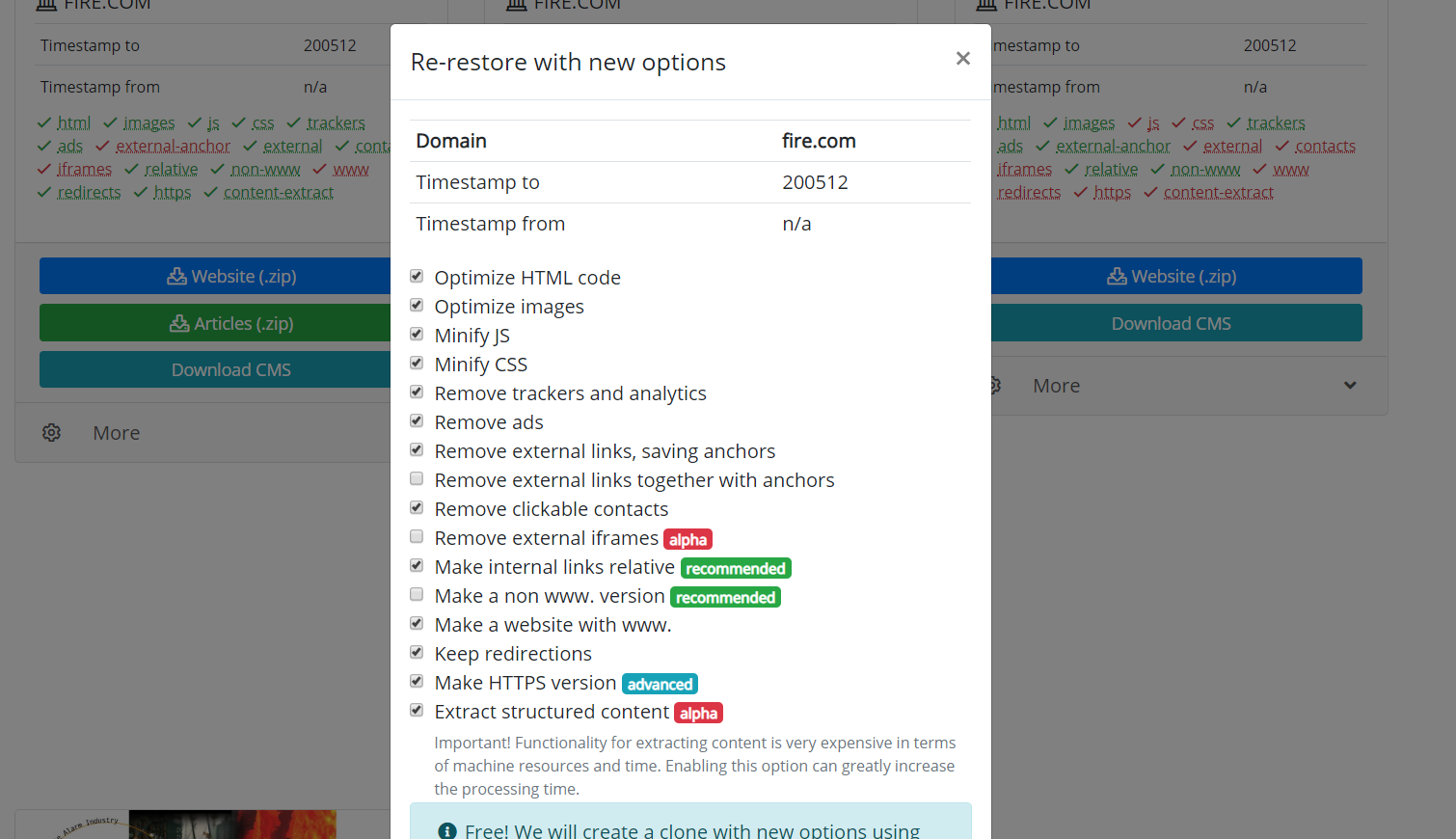

Vale anche la pena menzionare la possibilità di clonare siti Web ripristinati o scaricati. A volte capita che durante il recupero, si siano scelti altri parametri rispetto a quelli che si sono rivelati necessari alla fine. Ad esempio, la rimozione di collegamenti esterni non era necessaria e alcuni collegamenti esterni necessari, quindi non è necessario ricominciare a scaricare. Hai solo bisogno di impostare nuovi parametri nella pagina di recupero e iniziare a ricreare il sito.

L'uso del materiale dell'articolo è consentito solo se la fonte è pubblicata: https://archivarix.com/it/blog/how-does-it-works/

Il sistema Archivarix è progettato per scaricare e ripristinare siti non più accessibili da Web Archive e quelli attualmente online. Questa è la differenza principale rispetto al resto dei "downloader…

Utilizzando l'opzione "Estrai contenuto strutturato" puoi facilmente creare un blog Wordpress sia dal sito trovato nell'Archivio Web che da qualsiasi altro sito. Per fare ciò, trova prima il sito di o…

Per semplificare la modifica dei siti Web ripristinati nel nostro sistema, abbiamo sviluppato un semplice file CMS Flat File costituito da un solo piccolo file php. Nonostante le sue dimensioni, quest…

Questo articolo descrive le espressioni regolari utilizzate per cercare e sostituire i contenuti nei siti Web ripristinati utilizzando il sistema Archivarix. Non sono univoci per questo sistema. Se co…

- Localizzazione completa di Archivarix CMS in 13 lingue (inglese, spagnolo, italiano, tedesco, francese, portoghese, polacco, turco, giapponese, cinese, russo, ucraino, bielorusso).

- Esporta tutti i dati del sito corrente in un archivio zip per salvare un backup o trasferirli su un altro sito.

- Mostra e rimuovi gli archivi zip danneggiati negli strumenti di importazione.

- Controllo della versione PHP durante l'installazione.

- Informazioni per l'installazione di CMS su un server con NGINX PHP-FPM.

- Nella ricerca, quando la modalità esperto è attiva, vengono visualizzati la data / ora della pagina e un collegamento alla sua copia nel WebArchive.

- Miglioramenti dell'interfaccia utente.

- Ottimizzazione del codice.

Se sei un madrelingua in una lingua in cui il nostro CMS non è ancora stato tradotto, ti invitiamo a migliorare ulteriormente il nostro prodotto. Tramite il servizio Crowdin puoi fare domanda e diventare il nostro traduttore ufficiale in nuove lingue.

- Supporto dell'interfaccia della riga di comando per la distribuzione di siti Web direttamente dalla riga di comando, importazioni, impostazioni, statistiche, cancellazione della cronologia e aggiornamenti di sistema.

- Supporto per password crittografate password_hash (), che possono essere utilizzate nella CLI.

- Modalità esperto per includere ulteriori informazioni di debug, strumenti sperimentali e collegamenti diretti a istantanee WebArchive salvate.

- Gli strumenti per immagini e collegamenti interni danneggiati ora possono restituire un elenco di tutti gli URL mancanti invece di rimuoverli.

- Lo strumento di importazione mostra i file zip danneggiati / incompleti che possono essere rimossi.

- Supporto dei cookie migliorato per soddisfare i requisiti dei browser moderni.

- Impostazione della scelta dell'editor predefinito per le pagine HTML (editor visuale o codice).

- La scheda "Modifiche" che mostra le differenze di testo, disabilitata per impostazione predefinita, può essere abilitata nelle impostazioni.

- Puoi tornare a una modifica specifica nella scheda "Modifiche".

- Corretto l'URL della mappa del sito XML per i siti web costruiti con il sottodominio www.

- Risolto il problema con l'eliminazione dei file temporanei creati durante l'installazione / importazione.

- Pulizia più rapida della storia.

- Rimosse le frasi di localizzazione inutilizzate.

- Cambio della lingua nella schermata di accesso.

- Pacchetti esterni aggiornati alle versioni più recenti.

- Utilizzo della memoria ottimizzato per il calcolo delle differenze di testo nella scheda Modifiche.

- Supporto migliorato per le vecchie versioni dell'estensione php-dom.

- Uno strumento sperimentale per correggere le dimensioni dei file nel database se hai modificato i file direttamente sul server.

- Uno strumento di esportazione di design piatto sperimentale e molto grezzo.

- Supporto sperimentale della chiave pubblica per future funzioni API.

- Risolto: la sezione Cronologia non funzionava se l'estensione php zip non era abilitata.

- Scheda Cronologia con i dettagli delle modifiche durante la modifica dei file di testo.

- Strumento di modifica .htaccess.

- Possibilità di ripulire i backup fino al punto di rollback desiderato.

- Il blocco "URL mancanti" è stato rimosso dagli Strumenti, come è accessibile dal pannello principale

- Aggiunto controllo e visualizzazione dello spazio libero su disco nel pannello principale.

- Miglioramento della verifica delle estensioni PHP necessarie all'avvio e all'installazione iniziale.

- Piccoli cambiamenti estetici.

- Tutti gli strumenti esterni aggiornati alle ultime versioni.

- Password separata per la modalità sicura.

- Modalità di sicurezza estesa. Ora puoi creare regole e file personalizzati, ma senza codice eseguibile.

- Reinstallazione del sito dal CMS senza dover eliminare manualmente nulla dal server.

- Possibilità di ordinare regole personalizzate.

- Ricerca e sostituzione migliorate per siti molto grandi.

- Impostazioni aggiuntive per lo strumento "View tag meta tag"

- Supporto per domini IDN sull'hosting con la vecchia versione di ICU.

- Nell'installazione iniziale con una password, viene aggiunta la possibilità di disconnettersi.

- Se .htaccess viene rilevato durante l'integrazione con WP, le regole di Archivarix verranno aggiunte all'inizio.

- Quando si scaricano siti per numero di serie, la CDN viene utilizzata per aumentare la velocità.

- Altri miglioramenti e correzioni minori.

- Nuova dashboard per la visualizzazione di statistiche, impostazioni del server e aggiornamenti di sistema.

- Possibilità di creare modelli e aggiungere comodamente nuove pagine al sito.

- Integrazione con Wordpress e Joomla in un clic.

- Ora in Ricerca-sostituzione, il filtro aggiuntivo viene eseguito come costruttore, in cui è possibile aggiungere un numero qualsiasi di regole.

- Ora puoi filtrare i risultati per dominio / sottodomini, data-ora, dimensione del file.

- Un nuovo strumento per ripristinare la cache in Cloudlfare o abilitare / disabilitare la modalità Dev.

- Un nuovo strumento per rimuovere il controllo delle versioni negli URL, ad esempio "?ver=1.2.3" in css o js. Ti consente di riparare anche quelle pagine che sembravano storte nel WebArchive a causa della mancanza di stili con versioni diverse.

- Lo strumento robots.txt ha la possibilità di abilitare e aggiungere immediatamente una mappa Sitemap.

- Creazione automatica e manuale di punti di rollback per le modifiche.

- L'importazione può importare modelli.

- Il salvataggio / importazione delle impostazioni del caricatore contiene i file personalizzati creati.

- Per tutte le azioni che possono durare più a lungo di un timeout, viene visualizzata una barra di avanzamento.

- Uno strumento per aggiungere un meta tag viewport a tutte le pagine di un sito.

- Gli strumenti per la rimozione di collegamenti e immagini interrotti hanno la capacità di tenere conto dei file sul server.

- Un nuovo strumento per correggere collegamenti urlencode errati nel codice HTML. Raramente, ma può tornare utile.

- Miglioramento dello strumento per gli URL mancanti. Insieme al nuovo caricatore, ora conta le chiamate a URL inesistenti.

- Suggerimenti Regex in Ricerca e Sostituzione.

- Controllo migliorato per le estensioni php mancanti.

- Aggiornato tutti gli strumenti js usati alle ultime versioni.

Questo e molti altri miglioramenti cosmetici e ottimizzazioni della velocità.